Feature Scaling

- Feature Scaling 特征缩放的目的是什么

- Feature Scaling Method #3

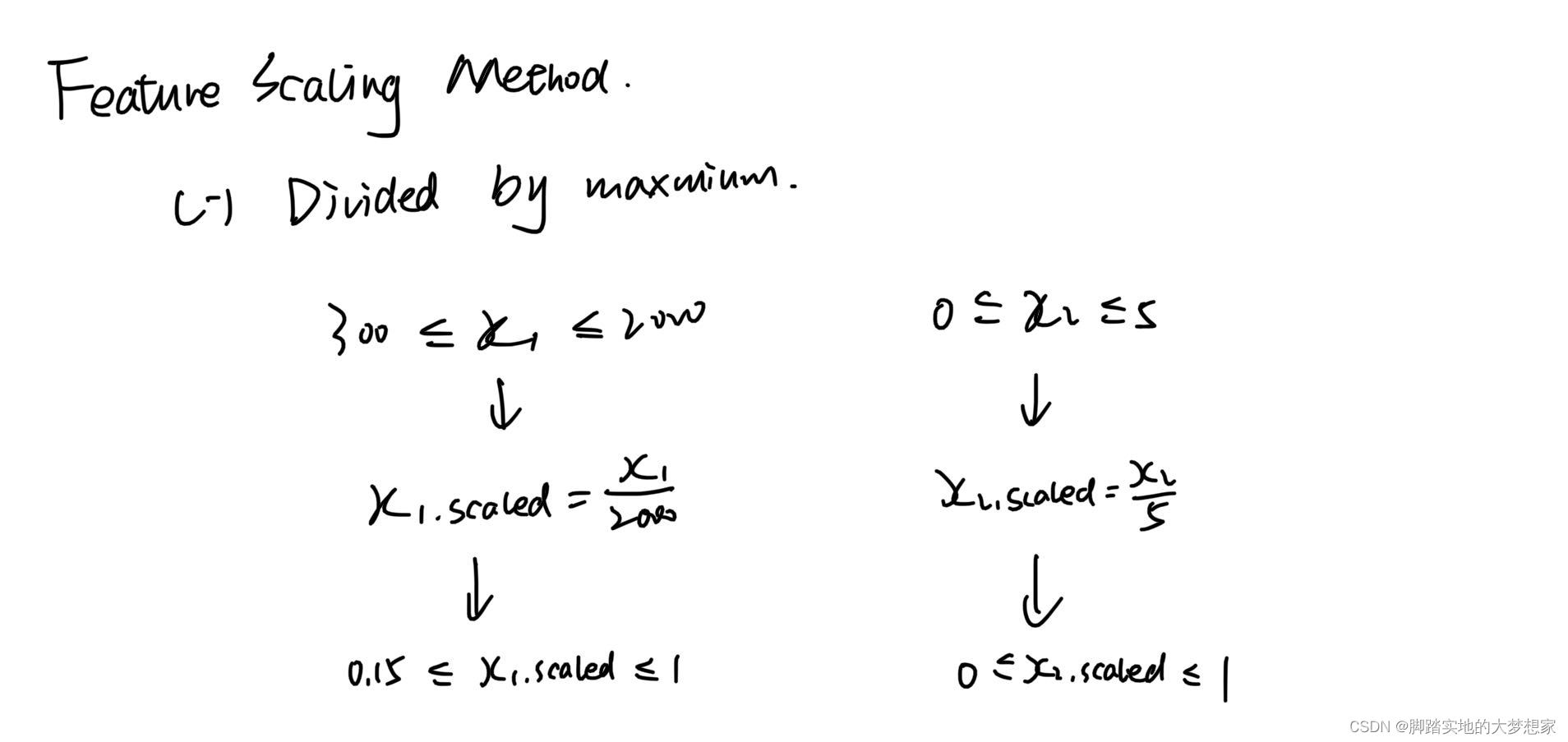

- Dividing by maximum

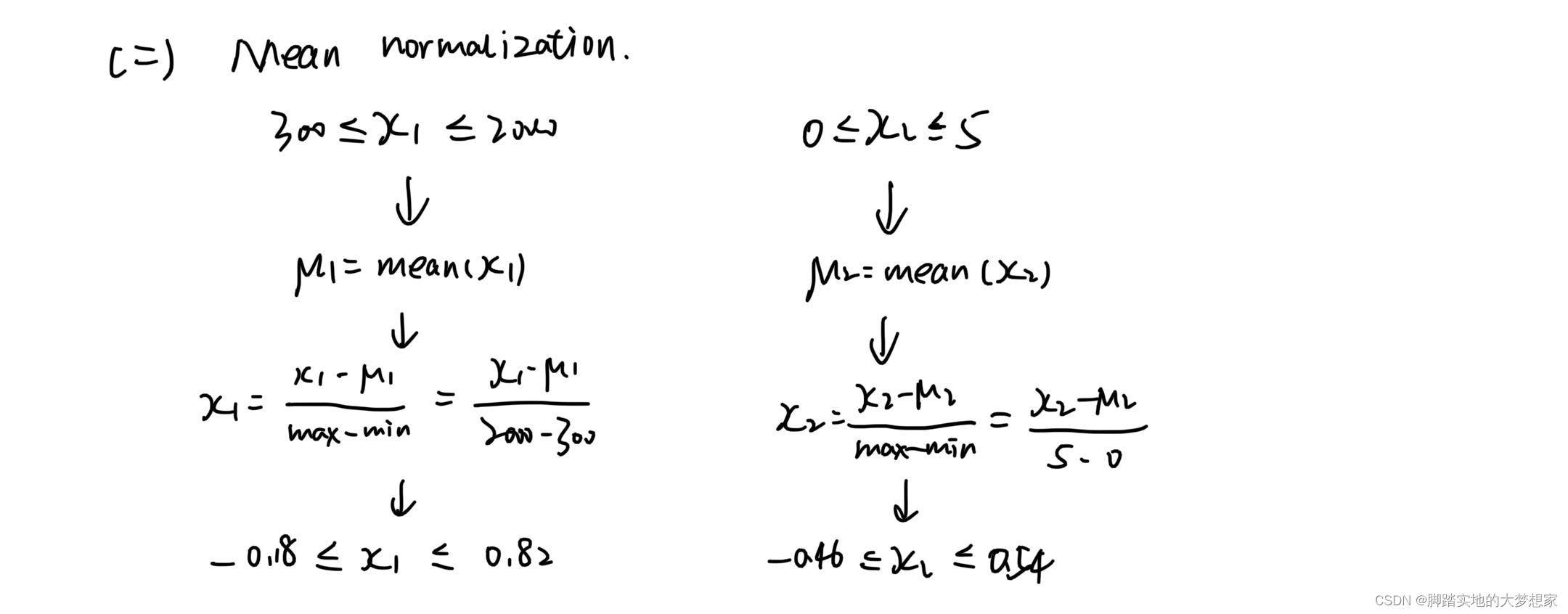

- Mean Normalization

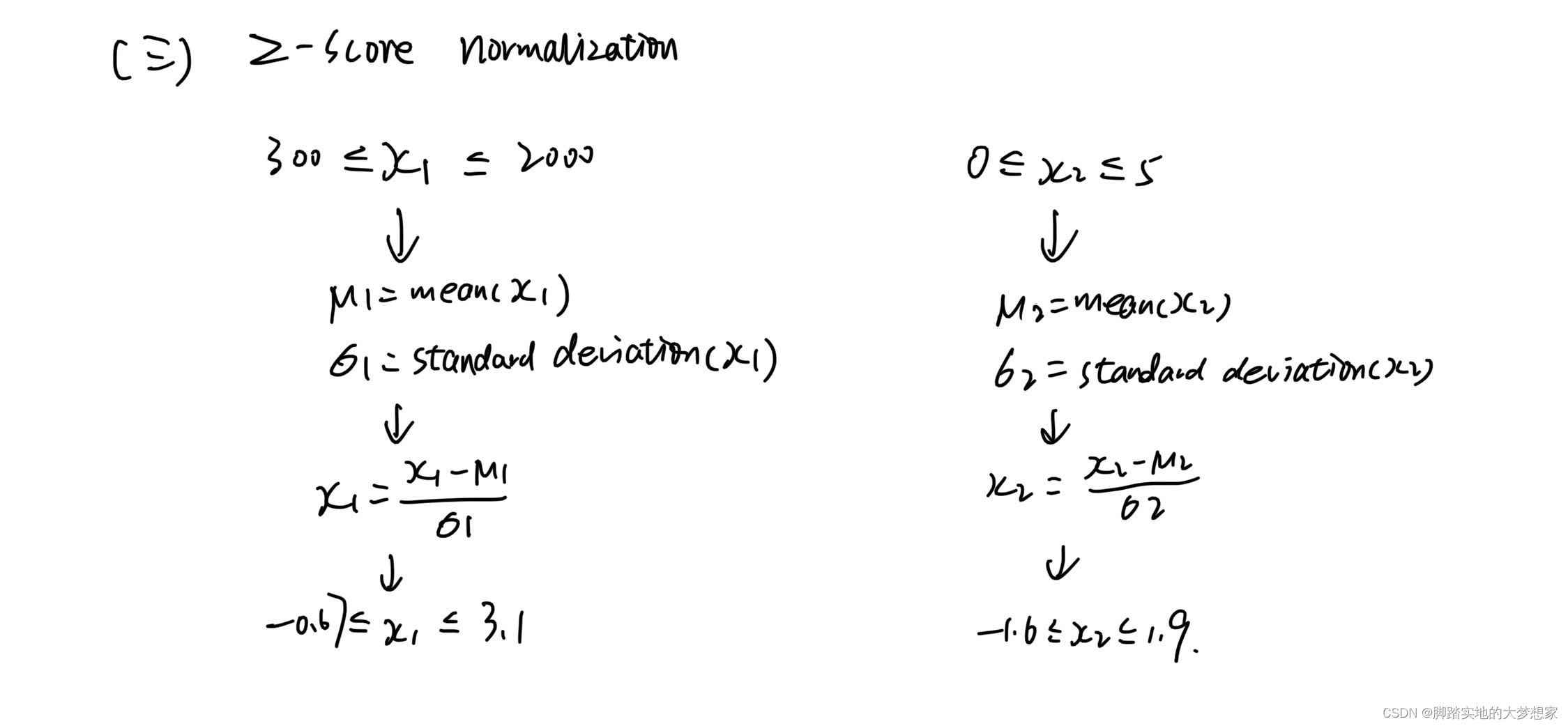

- Z-Score normalization

Feature Scaling 特征缩放的目的是什么

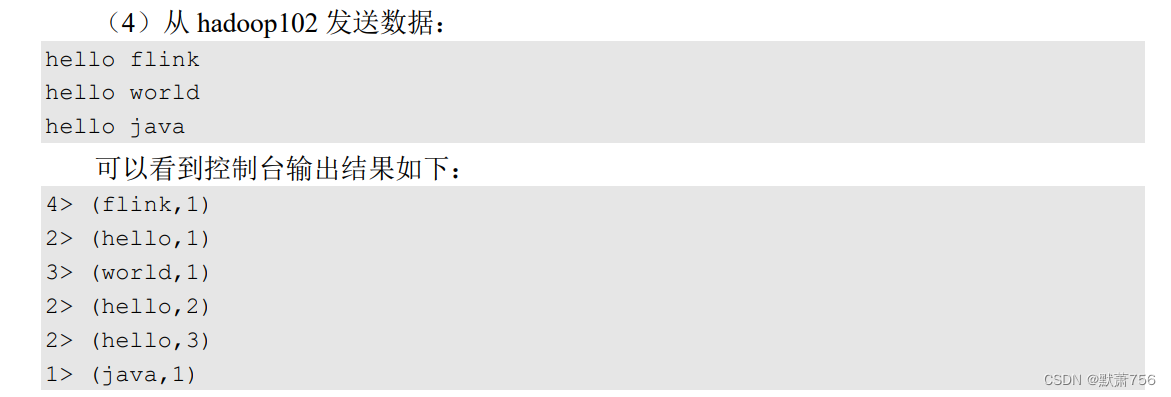

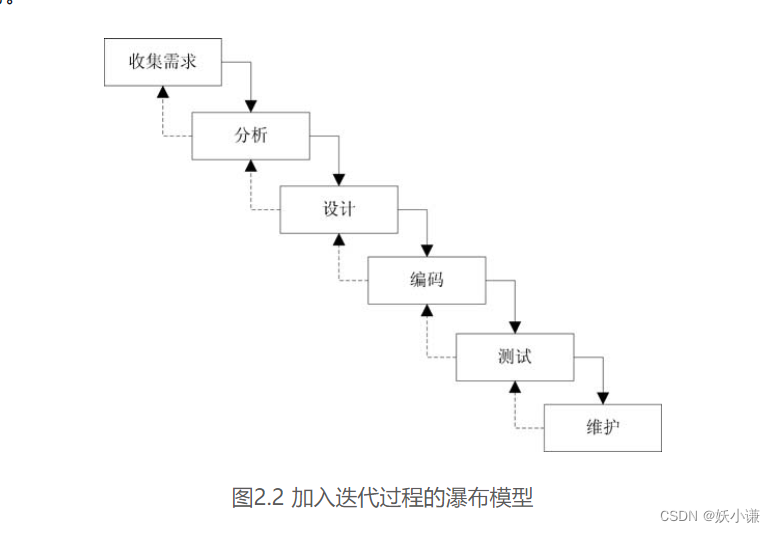

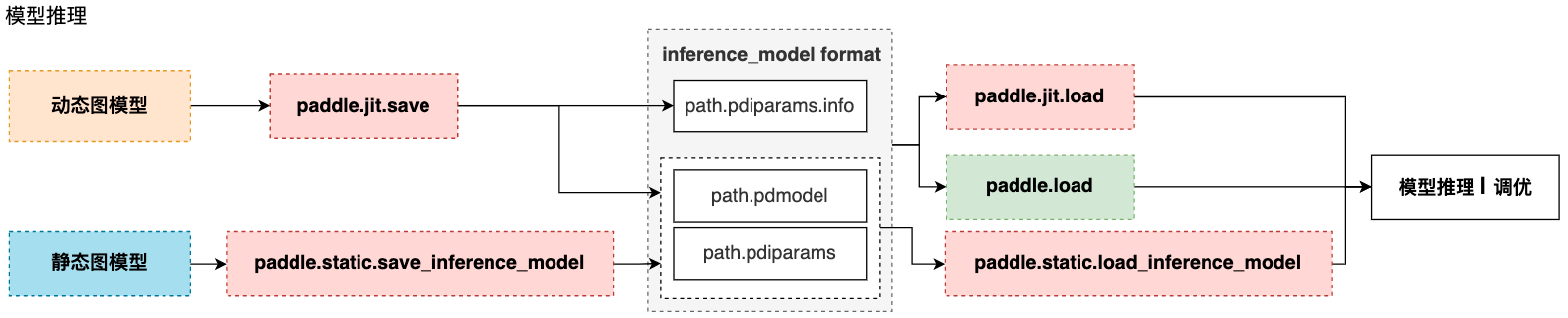

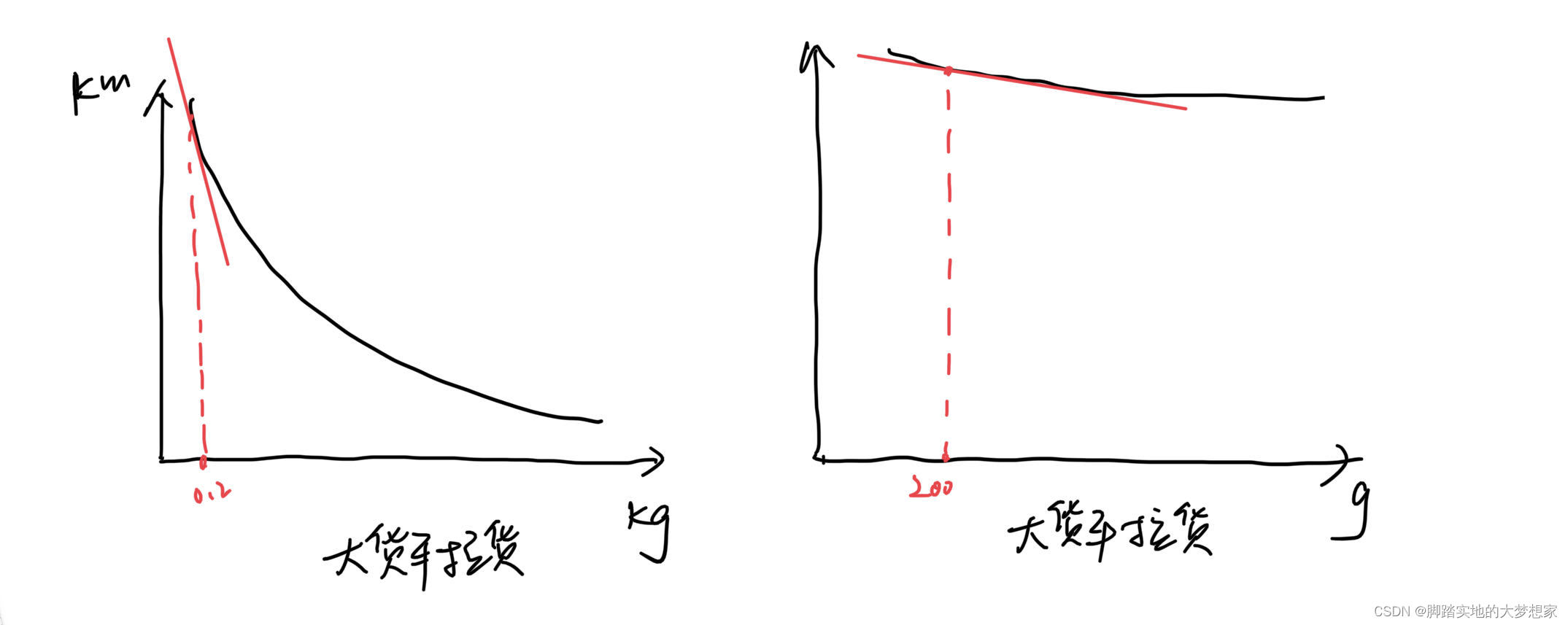

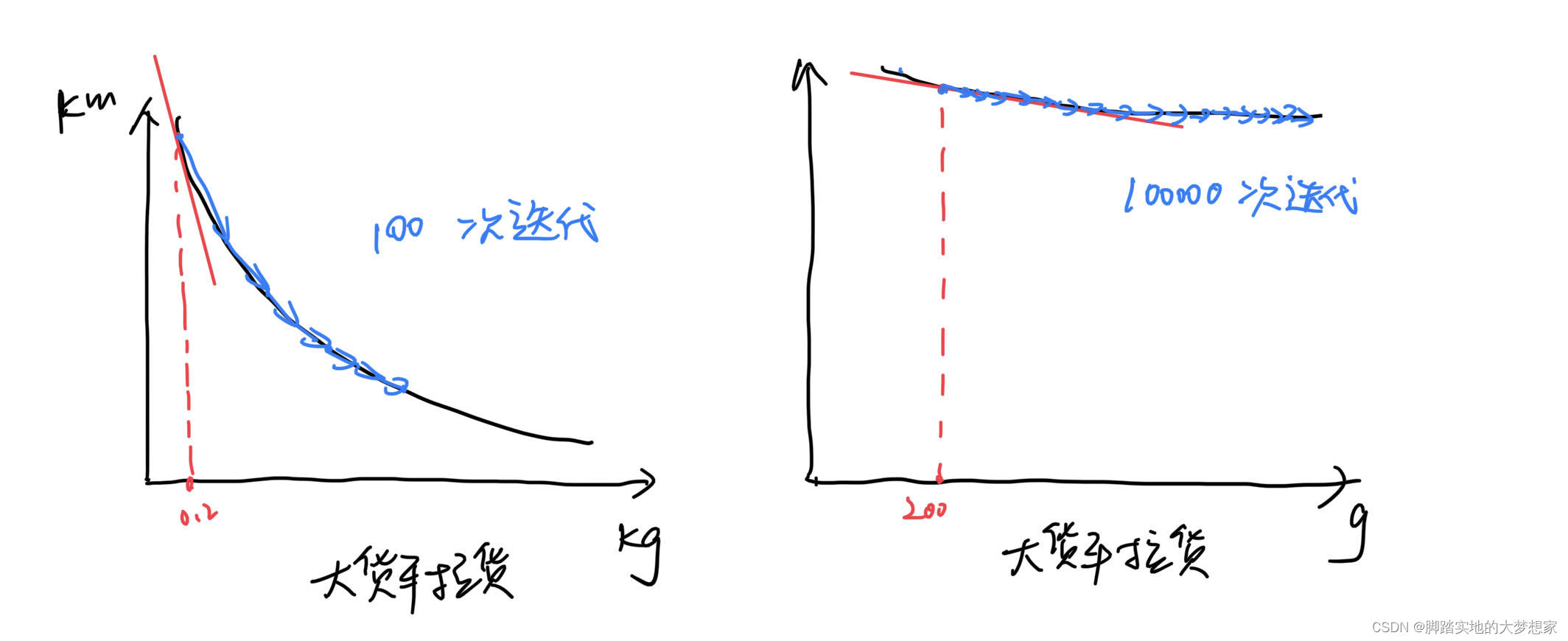

考虑前两个组图:

组图1:同一辆大货车拉货,同一个函数在x坐标的单位不同导致函数在同一个x下的斜率不同。

组图2:如果将两个函数分别做梯度下降,明显第一个需要更少的迭代次数就可以完成。

所以如果我们要做梯度下降的话,肯定更想选择第一个来做。如果第一个需要1天来完成,那么第二个则有可能需要100天甚至半年才出结果。

特征缩放的概念,就是将第二个图想办法做成第一个图,从而使得梯度下降更快,从而使得算法更加高效。

The technique “feature scaling” will enable gradient descent run much faster.

----Andrew Ng

Feature Scaling Method #3

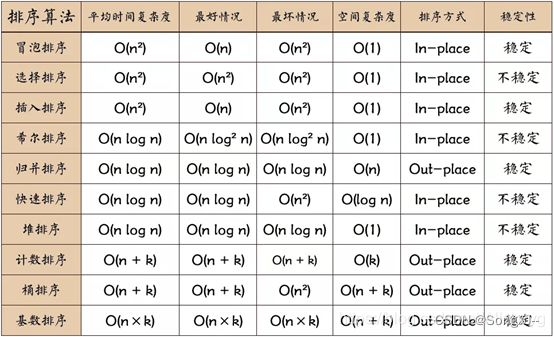

3种进行特征缩放的方法如下:

Dividing by maximum

Related python code

# 获得最大值

import numpy as np

a = [1,2,3,4,5]

maximum = np.max(a)

Mean Normalization

Related python code

# 获得平均值mean

import numpy as np

a = [1,2,3,4,5,6]

mean_value = np.mean(a)

Z-Score normalization

Basic knowledge:

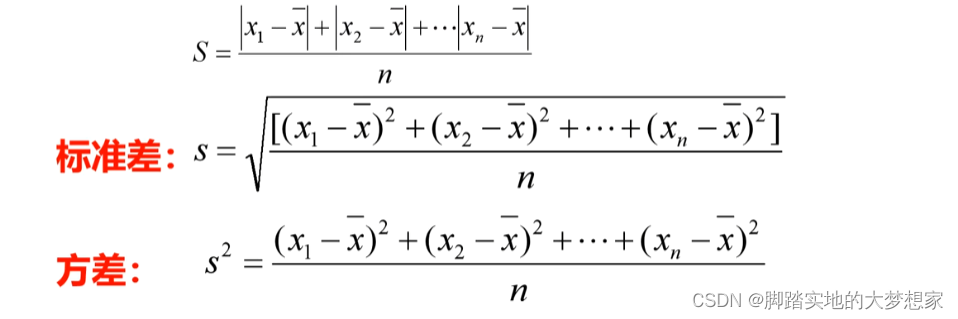

Standard Derivation

标准差和方差都是衡量一组数据离散程度的统计量,在实际计算中,标准差和方差越小,表示离散程度更小,即数据更加稳定。

Related python code

# 获得标准差值

import numpy as np

a = [1,2,3,4,5,6]

a_deri = np.std(a)

end —>