【GiantPandaCV引言】 还记得我在两个月前写的文章吗,关于yolov4-tiny+ncnn+int8量化的详细教程:NCNN+INT8+YOLOV4量化模型和实时推理

后来准备写yolov5+ncnn+int8量化的教程,却在yolov5的量化上遇到了麻烦,一方面是量化后速度更慢了,另一方面是精度下降严重,出现满屏都是检测框的现象,后来经过很多尝试,最终都以失败告终。

再后来,还是决定换其他方式对yolov5进行量化,一是即使最小的yolov5s模型量化后能提速,依旧满足不了我对速度的需求,二是对于Focus层,不管使用哪个向前推理框架,要额外添加对Focus层的拼接操作对我来说过于繁琐。

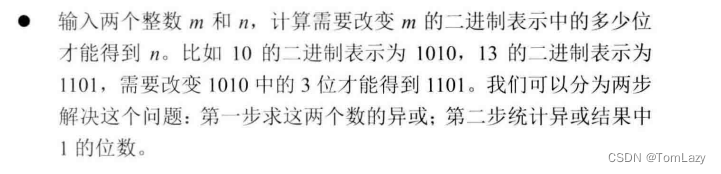

于是,我对yolov5做了一系列轻量化的改动,让他网络结构更加简洁,也能够实打实的提速(例如arm架构系列的树莓派,至少能提速三倍;x86架构的inter处理器也能提速一倍左右):

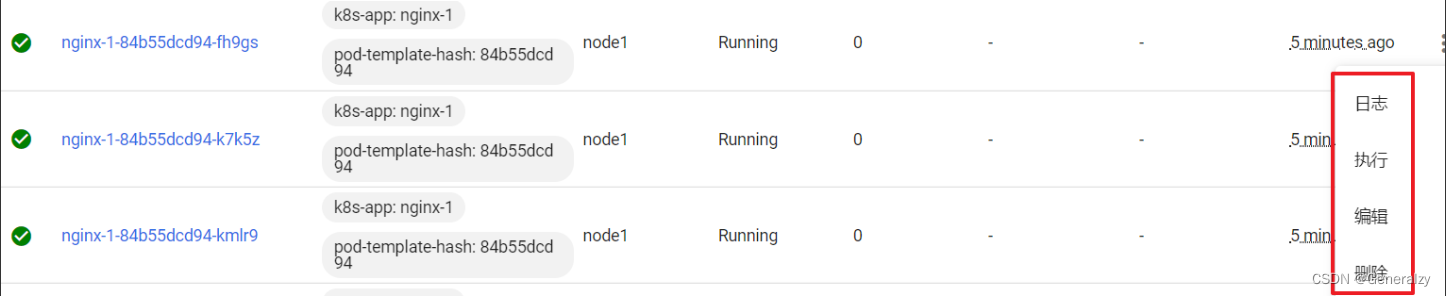

模型结构详见: