数据采集之爬取2019最好大学网站前四列排名 保存为csv文件格式 简单案例 BeautifulSoup

目录:

第一步 观察网页

第二步 使用requests、 BeautifulSoup解析数据

第三步 代码呈现结果

开始:

第一步 观察网页

第二步 使用request、 BeautifulSoup解析数据

...

导入包

....

import requests #第三方下载器

from bs4 import BeautifulSoup

import csv

...

定位抓取

...

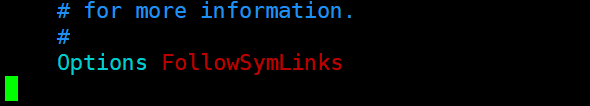

url='http://www.zuihaodaxue.com/zuihaodaxuepaiming2019.html'

re=requests.get(url,{'User-Agent': 'Mozilla/5.0'})

re.encoding='utf8'

soup=BeautifulSoup(re.text,'lxml')

list=[]

for tbody in soup ('tbody'):for tr in tbody ('tr'):td=tr('td')list.append([td[0].string+','+td[1].string+','+td[2].string+','+td[3].string])

...

保存csv文件...

with open('C:/Users/17792/Desktop/最好大学排名.csv','w',encoding='GBK',newline="") as file:head=['排名','学校名称','省份','总分']write=csv.writer(file)write.writerow(head)for i in list:for j in i :write.writerow(j.split(','))

第三步 代码呈现结果

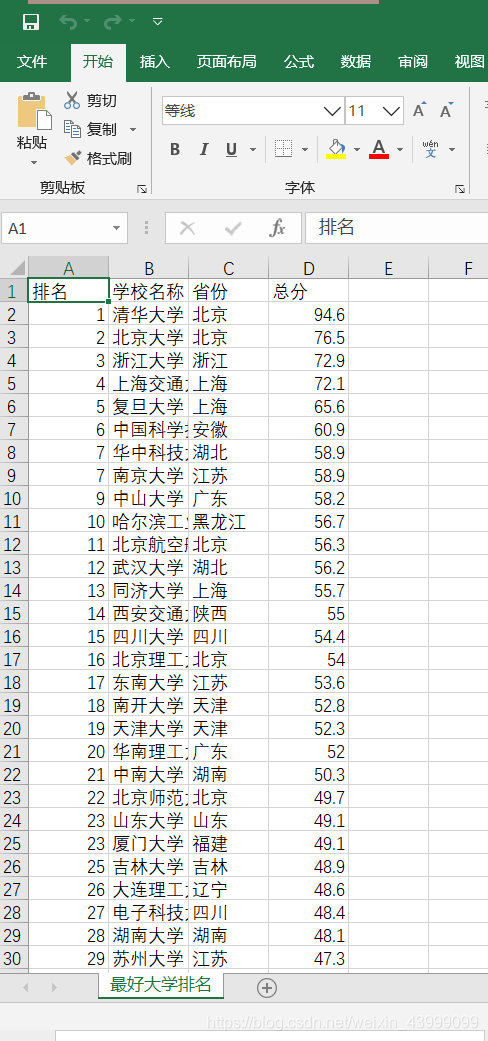

结果: