前言

实验数据来源自某看房网站,通过爬虫一共爬取了一千六百多条数据。能力有限,实验结果仅供参考。

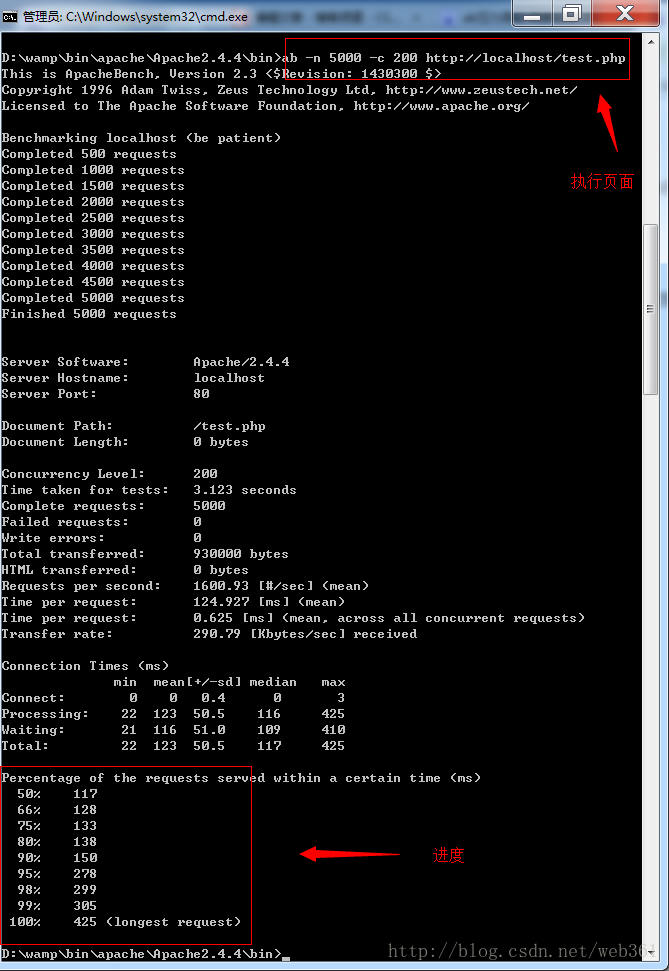

该网站几乎没有什么反爬虫措施,原理很简单,所以关键就是定位自己想要的信息。

工具

1、爬虫工具:request(爬虫包)、xpath(定位指定信息)

2、分析工具、pandas(数据分析工具)、tableau(可视化)

数据爬取

本次实验一共获取了以上三种数据:地址、单价和标签。先尝试了正则表达式过滤数据,发现正则表达式用起来比较麻烦,最后换成xpath的方法,简单粗暴。

def getHTMLText(url):try:header = {'User-Agent':'User-Agent:Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/**********}r = requests.get(url,timeout=20,headers=header) #设置超时# 正则表达式匹配#measures = re.findall('<span>建筑面积:(.*?)㎡</span>',r.text)# areas = re.findall('<span class="list-map" target="_blank">\[ (.*?) (.*?) ] ', r.text)#unit_price1 = re.findall('<span>(\d+)</span>', r.text)# print(len(areas))#通过Xpath定位(#<span>27000</span>,单价信息无法通过正则表达式定位)html = etree.HTML(r.text)infos = html.xpath('//*[@id="container"]/div[2]/div[1]/div[3]/*') # 通过xpath定位到指定位置#print(len(infos))for info in infos:try:tag = info.xpath('./div/a[4]/div/span/text()')[0].strip()tags.append(tag)except:tags.append(np.nan)try:area = info.xpath('./div/a[2]/span/text()')[0].strip()#print(area)areas.append(area)except:areas.append(np.nan)try:unit = info.xpath('./a[2]/p/text()')[1].strip()if ('元' in unit):units.append(unit)else:unit = info.xpath('./a[2]/p[2]/text()')[1].strip()units.append(unit)except:units.append(np.nan)# unit = info.xpath('./a[2]/p/text()')[2].strip()# units.append(unit)try:unit_price = info.xpath('./a[2]/p/span/text()')[0].strip()unit_prices.append(unit_price)except:unit_prices.append(np.nan)continueexcept Exception as e: #异常处理print(e)return "产生异常"

获得的数据如下:

数据预处理及可视化

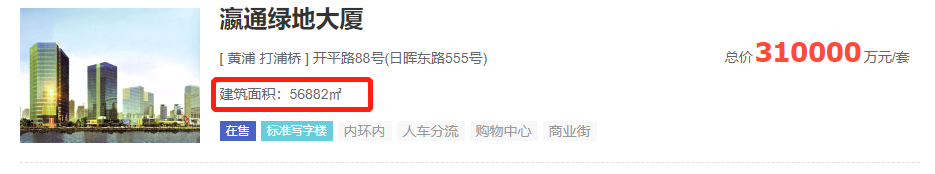

首先,从地址属性中提取房源所在区域的信息。首先来看一下最贵的房子,以为自己眼瞎了!!!!

赶紧到网站上求证一下:

原来如此。

fun = lambda x:x.split()[1]

dt['所在区'] = dt['地址'].map(fun)

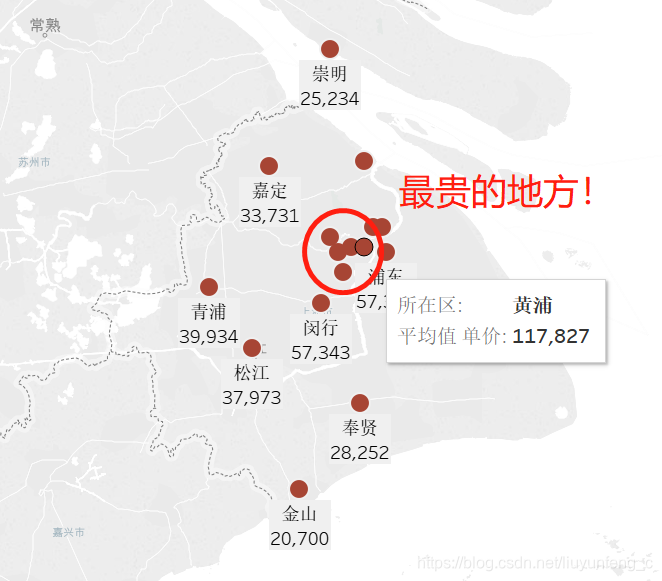

从数量上来看,可以看出浦东的新房源最多。我们再来看看各个地方的均价,做个排序,结果如下:

从数量上来看,可以看出浦东的新房源最多。我们再来看看各个地方的均价,做个排序,结果如下:

暂时就简单的看看这些内容,以后有时间再继续深入分析。

![[源码和文档分享]基于C#实现的电影网站数据爬虫和电影网站](https://upload-images.jianshu.io/upload_images/18423381-443186bdaff4825d.png)

![[源码和文档分享]基于JAVA FX实现的酒店预订系统网站](https://upload-images.jianshu.io/upload_images/18423381-6afd60a5b6cfbaea.png)

![[源码和文档分享]基于PHP和MYSQL数据库实现的公共考试报名管理系统网站](https://upload-images.jianshu.io/upload_images/18423381-ec5cea821b7174df.png)

![[源码和文档分享]基于Python的Django框架实现的中式快餐厅管理信息系统网站](https://upload-images.jianshu.io/upload_images/18423381-3cdd400f768772fe.png)

![[源码和文档分享]基于PHP和MYSQL数据库实现的libilibi电影论坛网站](https://upload-images.jianshu.io/upload_images/18423381-ecf470bb090ce7e1.png)

![网站使用国外空间或服务器[转载]](http://hiphotos.baidu.com/myh007/pic/item/ed7fe3553bf77407574e00f1.jpg)