GPT

相关视频:链接

OpenAI,在美国成立的人工智能研究公司,核心宗旨在于“实现安全的通用人工智能(AGI)”,使其有益于人类。 OpenAI于2015年由一群科技领袖,包括山姆·阿尔特曼(Sam Altman)、彼得·泰尔(Peter Thiel)、里德·霍夫曼(Reid Hoffman)和埃隆·马斯克(Elon Musk)等人创办

2019年7月22日微软投资OpenAI并与其合作;

微软-Open_ai:GPT;谷歌:BERT

bert让我们看到了希望,gpt让我们看到了未来

GPT1---微调阶段

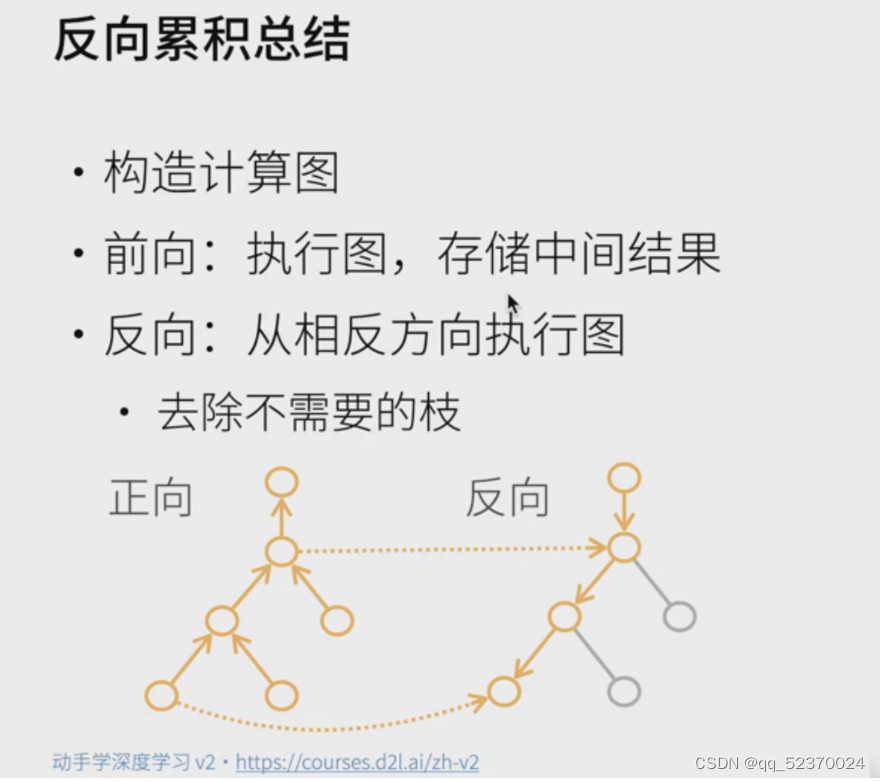

本质上是transformer的解码器,是自回归模型-生成模型,bert是自编码模型-完形填空

GPT2---基于prompt的通用阶段--1代的基础上增加数据和模型参数量

GPT2多样性控制参数:

3个参数:温度、topp、topk

温度低:准,温度高:多样性。

Topk:卡数量

Topp:卡概率和

其他值的概率置零,永远采样不到

GPT3:让模型学习人类偏好,然后给出输出—朝通用继续迈进

gpt3消耗的资源:10000个gpu

GPT3:zero-shot、one-shot、few-shot:

zero-shot:直接问答

one-shot:举一个例子

few-shot:举若干个例子

如果输入和输出费前后分别是翻译前后,那么模型就会知道你让它做翻译任务。

Fewshot:举若干个例子,然后再问他问题

不管是多少shot,都是拼接一起,自回归

网络结构:就是transformer,主要是要有海量的数据

CODEX:个性化机器人:用leetcode训练他的写代码能力

我们变成了少儿编程师

instructGpt

chatGpt