Huggingface:高效多GPU训练

- 概念

- 动态策略

- Single Node、Multi-GPU

- multi-node/multi-gpu

https://huggingface.co/docs/transformers/perf_train_gpu_many

概念

首先介绍一下名词概念:

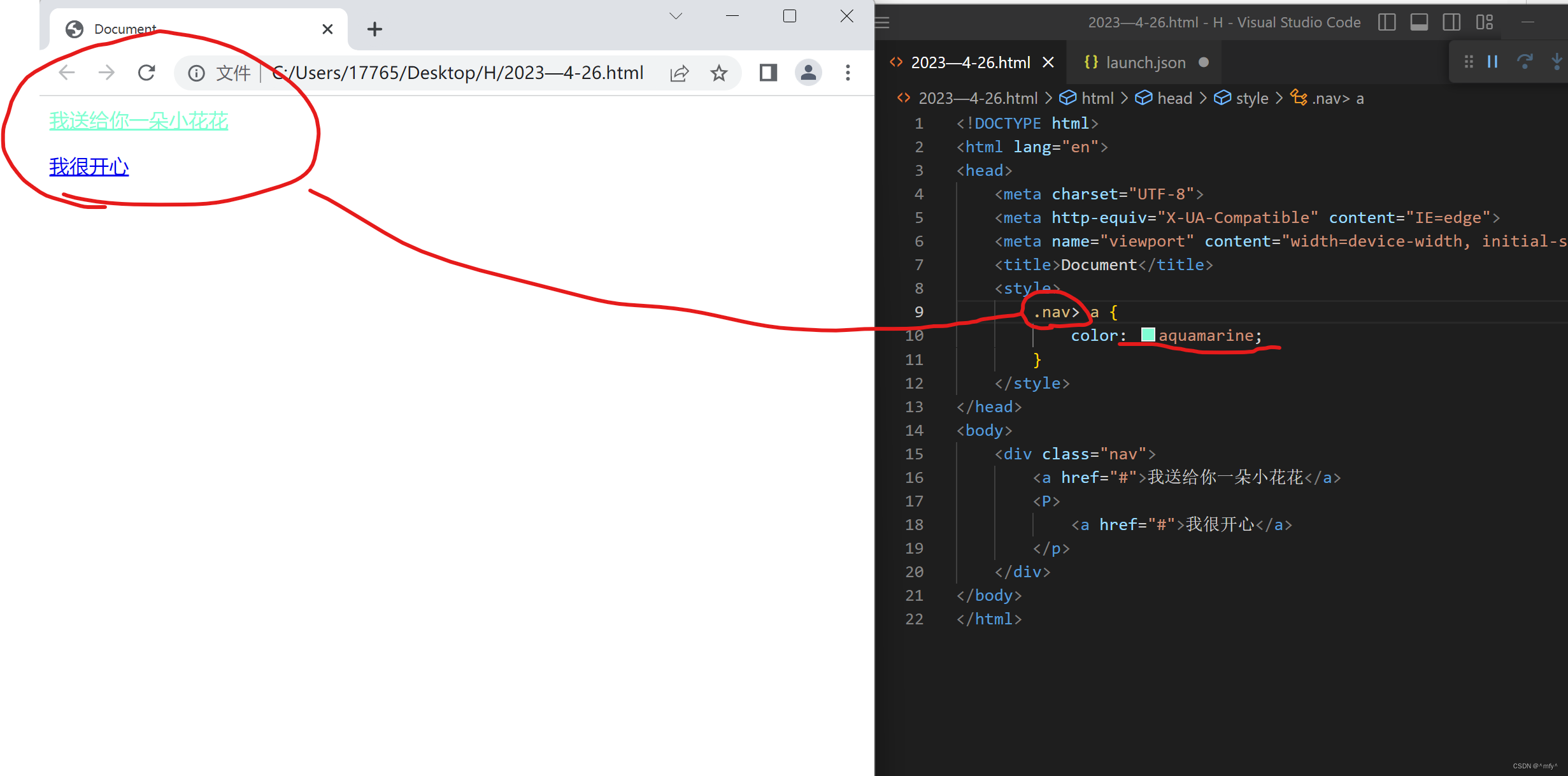

Data Parallel(DP):数据并行,相同的步骤多次执行,把一个batch的数据分成多份,该处理是并行的,所有步骤都会在结束时同步。

Tensor Parallel(TP):Tensor并行,把一整个tensor分成多份,每份被分配在指定的GPU上,在这个过程中,每份单独在不同的gpu上单独的运行,并最终同步结果。

Pipline Parallel(PP):把模型的一个层或者多个层放在一个单独的GPU,每个gpu并行处理模型的不同层。

Zero Redundancy Optimizer (ZeRO) :同样执行tensor分割操作,有些类似于TP,除了整个tensor被重建用于前向传播与反向传播,因此模型不需要被更改。也支持卸货操作,对与GPU受限的设备。

Sharded DDP:是基本ZeRO概念的另一个名称,用于各种其他ZeRO实现。

动态策略

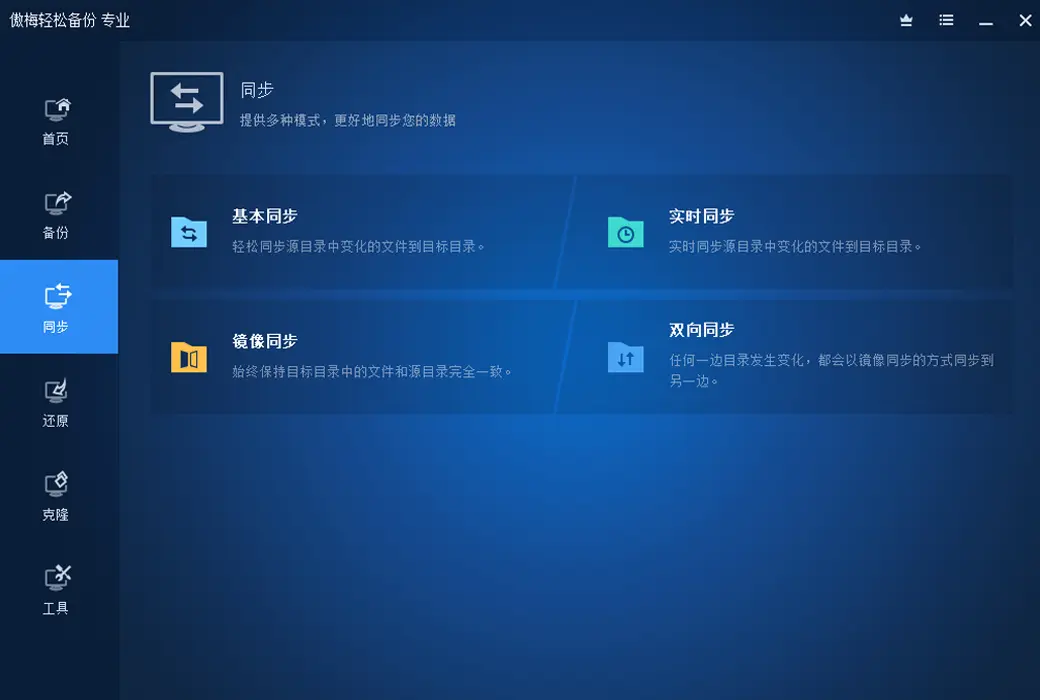

Single Node、Multi-GPU

适合在单GPU的策略:

- DDP

- Zero

不适合单GPU的策略:

3. DDP

4. Zero

5. TP

multi-node/multi-gpu

拥有快速节点连接:

ZeRO - as it requires close to no modifications to the model

PP+TP+DP - less communications, but requires massive changes to the model

没有快速节点连接:

DP+PP+TP+ZeRO-1